반응형

|

항등함수, 경사함수, 계단함수, 시그모이드 함수, Tanh 함수 ReLU 함수 |

I. 활성화 함수의 개요

가. 활성화 함수의 정의

- 입력 정보의 합성값을 은닉층이나 출력층으로 전달하기 위해, 일정 범위의 결합 값으로 전환하여 전달하는 함수

- 분류: 단극성/양극성, 선형/비선형, 연속/이진

나. 활성화 함수의 유형

|

유형 |

도식 |

설명 |

|

항등 함수 |

|

- 양극성 - 선형연속 함수 - 입력의 가중합이 그대로 출력

|

|

경사 함수 |

|

- 단극성 - 선형연속 함수

|

|

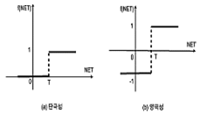

계단 함수 |

|

- 단극성 또는 양극성 - 이진 함수 - 디지털 형태의 출력이 요구되는 경우 주로 사용

|

|

시그모이드 함수 |

|

- 단극성 또는 양극성 - 비선형 연속 함수

|

|

Tanh 함수 |

|

- 쌍곡 탄젠트 함수

|

|

ReLU 함수 |

|

- 0 이하 입력은 0 출력 부분 활성화 - 선형함수, 미분계산 용이

|

반응형

'IT기술노트 > 인공지능' 카테고리의 다른 글

| 확률적 경사 하강법(Stochastic Gradient Descent, SGD) (0) | 2021.03.06 |

|---|---|

| Gradient (0) | 2021.03.06 |

| 손실함수(Loss Function) (0) | 2021.03.06 |

| exclusive OR 연산 (0) | 2021.03.06 |

| 퍼셉트론(Perceptron) (0) | 2021.03.06 |

| MCTS(Monte Carlo Tree Search) (0) | 2021.03.06 |

| Feed Forward Model (0) | 2021.03.06 |

| Q-러닝 (0) | 2021.03.06 |

댓글